Tempo di lettura stimato: 6'

Nell’ultimo articolo sul GDPR e intelligenza artificiale, ci siamo lasciati con una considerazione: dobbiamo avere la consapevolezza per capire se possiamo usare o no uno strumento potentissimo, come l’AI, l’intelligenza artificiale. Perché è come guidare una macchina da Formula 1 senza avere la patente. Questa consapevolezza ce l’abbiamo? Bene. Non ce l’abbiamo? Allora, stiamo giù e cerchiamo di costruirla.

È un discorso che ha a che vedere anche con un’altra questione: l’uso dell’intelligenza artificiale nelle attività di marketing.

Adesso seguimi, per favore, perché parliamo di un concetto un po’ complesso: il reinforced machine learning.

Sui sistemi di reinforced machine learning e tutte le “sporcaccionate di marketing” che si fanno sui siti web

Machine learning e reinforced machine learning. Sono due parole importanti: il machine learning è come le nuove intelligenze artificiali imparano. Reinforced machine learning, invece, è un’altra cosa e te la spiego con un esempio.

La Peppino srl ha un e-commerce. Un giorno scopre che può installare sul suo sito un bellissimo sistema di intelligenza artificiale per proporre a chi naviga il prodotto migliore per lui o per lei. Quindi, lo installa. È un sistema che fa due cose:

- impara da tanti altri siti quali possono essere le preferenze di una persona

- e, a fronte della navigazione degli utenti sull’e-commerce della Peppino srl, continua a imparare.

Per farlo, usa anche i dati personali di cui la Peppino srl è titolare, in quanto titolare del sito. È chiaro che questa cosa va gestita.

Quindi occhio ai sistemi di intelligenza artificiale che installi e che usi per fare marketing, perché devi avere la consapevolezza per usarli.

Anche perché sta arrivando l’AI Act.

AI Act: cos’è? È un regolamento e si applicherà nello stesso modo in tutti gli Stati membri dell’UE

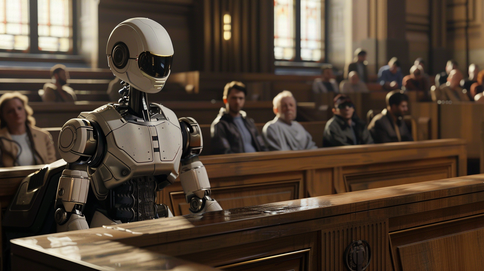

Spiegato semplice semplice, l'AI Act è un regolamento europeo che ha l’obiettivo di “regolamentare” l’uso dell’intelligenza artificiale. Ripeto: regolamento, non direttiva. Quindi? Quindi, perché diventi applicabile, non c’è bisogno di una norma di recepimento. Sarà valido in tutta l’Unione Europea allo stesso modo, come il GDPR.

L'AI Act, in sostanza ci dice questo: "Visto che gli strumenti di intelligenza artificiale sono macchine da Formula 1 nel trattamento dei dati e visto che gli utenti che li usano, se va bene, hanno la patente per guidare il triciclo - altrimenti non ci sarebbero problemi - dobbiamo dare un contesto, disegnare le strisce del campo da gioco, per far sì che i nostri cittadini, di cui dobbiamo tutelare i diritti, non si schiantino tutti contro il palo.”

E poi, all’articolo 3, l’AI Act ci dice una cosa importante: l’intelligenza artificiale è un sistema che deduce attraverso l’apprendimento automatico. Sottolineo: deduce.

Vuol dire che riesce a proporre soluzioni che non abbiamo mai visto.

Sempre l’articolo 3 ci dice un’altra cosa che trovo interessante, cioè che i sistemi di intelligenza artificiale hanno anche l'obiettivo di condizionare le persone. Sottolineo: condizionare.

Cosa vuol dire che l’intelligenza artificiale deduce?

Ce lo spiegano diversi video su YouTube che ci illustrano come è stato addestrato ChatGPT. Sono pieni di algoritmi e matematica… Quindi, se i numeri ti piacciono poco, ti spiego il concetto con un esempio. L’esempio di Peppino che deve “pittare” (tinteggiare) casa sua.

Negli anni, Peppino ha tinteggiato casa sua molte volte, in ogni occasione con colori diversi. La prima volta l’ha dipinta di bianco, la seconda di giallo, la terza di rosso, la quarta di verde. L'anno prossimo come la pitturerà? L'intelligenza artificiale che deduce è in grado di proporre il colore per il prossimo anno.

A fronte del comportamento passato, deduce. Chiaro?

Perché è importante l'AI Act?

L’AI Act è importante perché, oltre a dare delle definizioni, contribuisce a realizzare uno degli obiettivi dell'Unione Europea: creare un mercato digitale unico. Lo trovo abbastanza corretto.

“Eh, ma tanto ci sono gli americani, i cinesi e i russi...”

Vero. Fino a poco più di un anno fa, tantissime server farm erano in Russia. E oggi?

Oggi, te la sentiresti di avere il tuo e-commerce su un portale russo?

Eh…secondo me mica tanto…

Quindi, la scelta di avere un mercato digitale unico serve. E per costruire un mercato unico devo lavorare in maniera tale da costruire delle regole che me lo permettano.

E allora l'AI Act dice "Guarda, le intelligenze artificiali che lavoreranno in Europa sui dati degli europei, dovranno subire un auditing e una certificazione.”

L'idea la trovo assolutamente corretta. L'applicazione forse rischia di diventare complessa. Ci riusciranno? Lo spero e spero che riescano a costruire un percorso di certificazione in grado di verificare in maniera corretta i comportamenti di questi sistemi, perché tutelino i diritti degli interessati.

Il “Machine unlearning” sarà fondamentale per la scelta dei sistemi di intelligenza artificiale

Un'altra cosa importantissima e che tutti dovrebbero conoscere se pensano di usare sistemi di intelligenza artificiale in generale e anche applicati al marketing, è il machine unlearning (la macchina che disimpara).

Perché questi sistemi imparano, imparano, imparano... alcune volte meglio alcune volte no. Ma cosa succede se imparano "sbagliato"? In che senso imparano sbagliato?

Perché, se l’IA viene addestrata in maniera non corretta, arrivano i problemi.

Esempio: i dati delle persone e della loro solvibilità. Perché in tantissime città degli USA gli afroamericani non riuscivano ad avere un mutuo? Perché l'IA è stata addestrata in maniera non corretta. A questo proposito, segnalo un approfondimento interessante sui danni dell’intelligenza artificiale nel settore bancario.

Il machine unlearning non è tanto una questione di “sprogrammare” l’IA, ma di far sì che disimpari, per poterle dare degli altri feedback. Questa possibilità diventerà fondamentale nella scelta dei nostri sistemi.

Se sceglieremo un sistema che non ha il machine unlearning, sceglieremo un sistema vecchio, incapace di correggere l’errore.

Aspettativa VS realtà: l’intelligenza artificiale non è un micro-ninja che ti fa fare tutto…

Io lo so che l'aspettativa quando si usa l’intelligenza artificiale è quella di Peppino, che si occupa di marketing e appena ha visto l’IA ha iniziato a dire: “Adesso, uso l'intelligenza artificiale per fare meglio, per fare su, per fare giù. Le faccio fare i testi. Le faccio fare la profilazione. Le faccio fare tutto…”

Come se fosse un micro-ninja… invece, la realtà è che ci ritroviamo ad avere una Ester Ascione… Hai presente il robot umanoide di GialappaShow? Ecco, molte intelligenze artificiali sono così. Ti sembra che ci sia sostanza, ma poi stringi stringi... ce n’è poca.

In realtà, i sistemi di IA, adesso, servono come strumento affinché forniamo delle informazioni e poi, magari, la terza o la quarta release sarà migliore.

Intanto noi stiamo dando dei dati e le implicazioni GDPR non sono banali.

Intanto stiamo dando dei dati…

Prova a chiedere a ChatGPT questa cosa:

"Che problemi ci sono nell'usare l'intelligenza artificiale per il marketing?"

Dice tutto. È bravissima! Poi, alla fine, dice: “è sempre consigliabile consultare un professionista della privacy.

In sostanza, ci dice che possiamo usarla senza problemi per fare copy, ricerche di mercato, creazione di immagini completamente nuove - basta non usare la faccia di Peppino e modificarla! - e di tutto ciò che non implica un trattamento di dati personali.

Quindi, ciò che non implica un trattamento di dati personali non ha problemi.

Per tutto il resto, devo avere la consapevolezza di cosa fare, di cosa sto facendo, di quali dati sto dando, eventualmente creare l'informativa, metterla nel registro, fare un'analisi dei rischi e una valutazione d’impatto.

E su questo… io mi chiederei:

- Come fai a fare un'analisi dei rischi di un'intelligenza artificiale?

- Che cosa ci metti?

- Le informazioni che ci metti per che cosa verranno usate?

- Lei impara, può usare informazioni, poi che cosa succede?

Attenzione. È vero che usare queste tecnologie ci dà un vantaggio competitivo. Ma non è detto che questo vantaggio competitivo non vada a discapito dei diritti dell'interessato, che non vada a discapito delle informazioni che i nostri interessati ci danno e che noi dobbiamo gestire… Quindi, nella scelta degli strumenti e nel loro uso, dobbiamo avere la consapevolezza per capire cosa fanno, come lo fanno, quali garanzie GDPR danno.

Bene. Per esempio, dopo che il Garante italiano è intervenuto, OpenAI ha dato contezza di queste cose, per permettere a chi usa ChatGPT di sapere che tipo di dati vengono trattati e in che modo. Prima non era chiaro. Se non fosse stato per l'autorità Garante saremmo ancora qui a dire: "Ma cosa fa ChatGPT? Boh...!” sparandoci dentro di tutto…

Come quelli che usano Midjourney e ci mettono dentro la foto della moglie o dell'amante… e dicono "Fammela più bella…”

Come quelli che usano Midjourney e ci mettono dentro la foto della moglie o dell'amante… e dicono "Fammela più bella…”

E intanto la foto di qualcuno è finita da qualche parte...

È un vantaggio competitivo. Ma è un vantaggio competitivo che va gestito.

RIPRODUZIONE RISERVATA. Ne è consentito un uso parziale, previa citazione della fonte.